Inhalte

- • Produktionssteigerung

- • Automatisierung einfacher Aufgaben

- • Viraler Content für soziale Medien

- • Content-Ideen

- • Zielorientierte Artikel und Blogbeiträge

- • Codierung

- • Vereinfachung komplexer Konzepte

- • Veralteter Trainingsdatensatz

- • Forschungsphase und falsche Informationen

- • Die Hybris

- • Problematische Dienstleistung

- • Systematische Fehler

Gestatten, ChatGPT mein Name

GPT-4: A Star is born?

Ja, das KI-Sprachmodell GPT-4 ist erschienen! Und wieder ist das gesamte Netz in hellster Aufregung. Wie es scheint, hat der neue multimodale Sprössling von OpenAI seine Fähigkeiten im kreativen Schreiben weiter ausgebaut und ist nun auch in der Lage, längere Zusammenhänge und visuelle Elemente besser zu verstehen. Vorerst wird GPT-4 nur im Bezahlmodus GPT-4 Plus und als API für Entwickler zum Bauen eigener Anwendungen verfügbar sein, wobei für den API-Zugriff eine Warteliste besteht.

GPT-4 vs ChatGPT

GPT-4 unterscheide sich laut OpenAI-CEOSam Altman in seiner Konversationsfähigkeit nur sehr geringfügig von GPT-3.5, welches das KI-Modell hinter ChatGPT ist. Die Architektur dürfte also nicht bahnbrechend verändert worden sein, und das Modell wird wohl weiterhin ein humanoides, aber noch lange kein menschengleiches neuronales Netzwerk aufweisen.

Das Sprachverarbeitungsmodell ChatGPT steht an der Spitze der GPT-3-Modelle und wurde vom No-Profit-Unternehmen OpenAI hergestellt. Seit seiner Lancierung macht es On- und Offline regelrecht Furore. Es erstellt Texte, kann diese zusammenfassen, übersetzen oder vereinfachen und benutzt dazu das Verfahren des Deep Learnings. In diesem Beitrag werden wir aufzeigen, inwiefern diese KI ein wahrhaftes Sprachgenie ist, und weshalb es dennoch nicht für alle Use Cases das richtige Tool zur Content Automation ist.

OpenAI

Die Non-Profit-Organisation OpenAI wurde im Jahr 2015 von Elon Musk, Sam Altman und anderen Investoren in San Francisco ins Leben gerufen. Das ambitionierte Team von OpenAI versteht sich als Blue-Sky-Forschungslabor zu den Möglichkeiten der künstlichen Intelligenz und macht die Ergebnisse der Öffentlichkeit zugänglich. Erklärtes Ziel von OpenAI ist die Erschaffung einer zunehmend leistungsfähigen, menschenähnlichen Intelligenz.

Neben GPT-1, GPT-2, GPT-3 und GPT-4 hat OpenAI über die Jahre mehrere KI-Produkte hergestellt:

OpenAI Gym

Toolkit für die Entwicklung und den Vergleich von Reinforcement-Learning-Algorithmen

OpenAI Universe

Softwareplattform zum Messen und Trainieren der allgemeinen Intelligenz einer KI

OpenAI Five

System, das das Videospiel Dota 2 gegen sich selbst spielt

Die GPT-Familie

Generative Pre-Trained Transformer (GPT) ist eine Familie von Sprachmodellen, die im Allgemeinen auf einem großen Korpus von Textdaten trainiert werden, um menschenähnlichen Text zu erzeugen. Das 'Vortraining' im Namen bezieht sich auf den anfänglichen Trainingsprozess auf einem großen Textkorpus, bei dem das Modell lernt, das nächste Wort in einer Passage vorherzusagen.

Die Einführung des Sprachmodells hat die Welt der Künstlichen Intelligenz definitiv in eine neue Ära geführt, da es sich bei diesem Sprachtransformator um ein maschinelles Lernsystem handelt, dessen Algorithmus nicht für eine spezifische Aufgabe geschult wird.

GPT-1

2018 entwickelte OpenAI ein allgemeines, Aufgaben-übergreifendes Modell (GPT-1), dessen generatives Vortraining anhand eines Book-Corpus durchgeführt wurde. Das Modell verwendete unüberwachtes und halbüberwachtes Lernen. Die ursprüngliche GPT-Studie zeigte, wie ein generatives Sprachmodell in der Lage ist, Wissen über die Welt zu erwerben und weitreichende Abhängigkeiten zu verarbeiten.

Das halbüberwachte Lernen beinhaltet drei Komponenten:

- Unüberwachte Sprachmodellierung ('Vortraining'): Für das unüberwachte Lernen wurde ein Standard-Sprachmodell verwendet.

- Überwachtes Fine-Tuning: Maximierung der Wahrscheinlichkeit eines bestimmten Labels bei gegebenen Merkmalen.

- Aufgabenspezifische Eingabeumwandlungen: Umwandlung der Eingaben in geordnete Sequenzen.

GPT-1 schnitt in 9 von 12 verglichenen Aufgaben besser ab als speziell trainierte, überwachte Spitzenmodelle. Eine weitere wichtige Errungenschaft war seine Fähigkeit des Zero-Shot-Learnings.

GPT-2

2019 wurde GPT-2 veröffentlicht, wobei die Vollversion aus Sorge vor möglichem Missbrauch nicht sofort freigegeben wurde. Der WebText-Corpus enthält über 8 Millionen Dokumente mit insgesamt 40 Gigabyte Text. Die wichtigste Änderung war ein größerer Datensatz mit 1,5 Milliarden Parametern – 10 Mal mehr als GPT-1 mit 117 Millionen Parametern.

GPT-2 hat gezeigt, dass das Training an größeren Datensätzen und mit mehr Parametern die Fähigkeit des Sprachmodells, Aufgaben zu verstehen, um ein Wesentliches verbessert. Somit war der Grundstein für GPT-3 und ChatGPT gelegt.

GPT-3

OpenAI entwickelte das GPT-3-Modell mit 175 Milliarden Parametern, 100 Mal mehr als GPT-2. Dank seiner großen Kapazität kann GPT-3 Artikel schreiben, die schwer von menschlich geschriebenen zu unterscheiden sind. Es kann auch spontan Aufgaben ausführen, für die es nie explizit trainiert wurde.

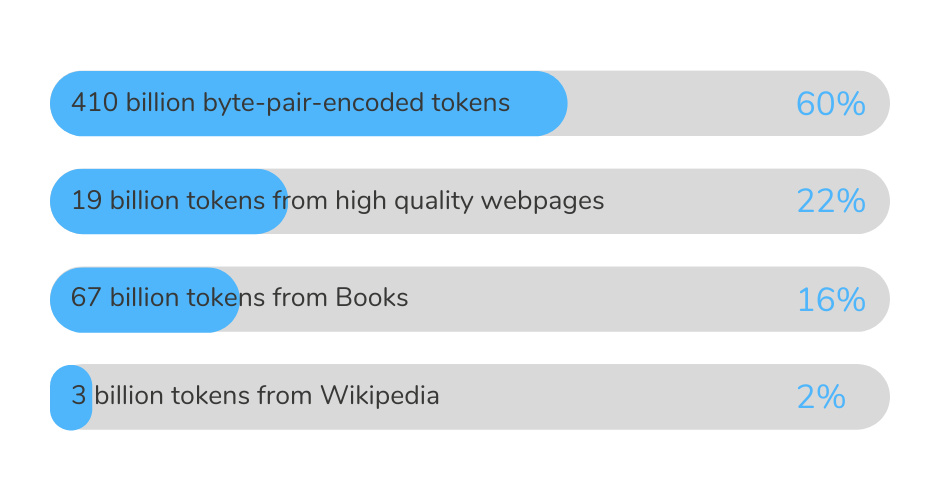

ChatGPT ist die Spitze der GPT-3-Familie. Es handelt sich um einen Chatbot, der im November 2022 auf den Markt kam. Er wurde mit einem riesigen und vielfältigen Textkorpus sowie mit Hunderten von Milliarden von Wörtern vortrainiert:

Mit ChatGPT befinden wir uns also bereits in der 3. Generation von GPT-Modellen. Das bedeutet, dass ChatGPT nicht wirklich eine Revolution in der Textautomatisierung darstellt.

GPT-4

GPT-4 wurde mit 100 Billionen Parametern trainiert, im Vergleich zu 175 Milliarden bei GPT-3. Alignment ist eine verbesserte Abstimmung zwischen User-Prompts und Textoutput. Allerdings will sich OpenAI eher darauf konzentrieren, die GPT-Modelle zu optimieren, anstatt sie unbegrenzt zu vergrößern.

Die Textausgabe ist bei GPT-4 nicht skalierbar. Auch wird das Modell weiter 'halluzinieren'. Der wichtigste Unterschied ist die Möglichkeit, Bilder als Input zu verarbeiten. Wie auch bei GPT-3 wurde GPT-4 nur mit Daten bis zum Jahr 2021 gefüttert.

Lernmethoden

Die verschiedenen GPT-Modelle benutzen unterschiedliche Lernmethoden:

Überwachtes maschinelles Lernen

Alle Daten im Datensatz sind gelabelt, und die Algorithmen lernen, die Ausgabe anhand der Eingabedaten vorherzusagen. Gelabelte Daten sind Daten, für die ein Vorverständnis besteht, z.B. ein Bild mit dem Label 'Katze' oder 'Hund'.

Unüberwachtes maschinelles Lernen

Alle Daten sind ungelabelt. Die Algorithmen lernen, eine innewohnende Struktur zu erkennen. Ungelabelte Daten sind Daten in ihrer Reinform.

Teilüberwachtes Lernen

Einige Daten sind gelabelt, die meisten nicht. Mischung aus überwachten und nicht überwachten Methoden. Ein kleiner Bestand an gelabelten Daten und ein großer Bestand an ungelabelten Daten werden benutzt.

Reinforcement Machine Learning

Der Algorithmus erkennt durch Versuch und Irrtum, welche Aktionen am meisten belohnt werden. Das ideale Verhalten in einem bestimmten Kontext soll bestimmt werden.

"Falsches" Lernen und toxische Sprache

Die Trainingsdaten enthalten gelegentlich toxische Sprache. OpenAI hat diverse Maßnahmen ergriffen, um die Menge an unerwünschtem Content zu reduzieren. Im Vergleich zu GPT-1 und 2 generiert GPT-3 dank dieser Maßnahmen weniger toxischen Content.

Bereits im Jahr 2021 gab OpenAI bekannt, dass genügend Sicherheitsvorkehrungen getroffen wurden, um den Zugang zu seiner API uneingeschränkt zu ermöglichen.

Welche Lernmethode setzt ChatGPT ein?

ChatGPT setzt sowohl überwachtes Lernen als auch das Reinforcement Learning ein. Bei beiden Ansätzen werden menschliche Trainer eingesetzt, um die Leistung des Modells mit Hilfe von 'Belohnungsmodellen' und einem Proximal Policy Optimization-Algorithmus (PPO) zu verbessern.

ChatGPT ist so trainiert, dass es auf der Grundlage vorangegangener Token vorhersagen kann, was das nächste Token ist.

Was sind Token?

Token sind das Ergebnis eines Prozesses, der Tokenisierung genannt wird. Er besteht in der Abgrenzung und eventuellen Klassifizierung von Abschnitten einer Reihe (String) von Eingabezeichen. In den GPT-Modellen wurde das Sprachverständnis im Rahmen der Verarbeitung natürlicher Sprache (NLP) durch einen Prozess des generativen Pre-Trainings auf einem vielfältigen Korpus verbessert.

Schlusswort

Die GPT-Familie von OpenAI stellt einen bemerkenswerten Fortschritt in der Künstlichen Intelligenz und den NLG-Technologien dar. Besonders ChatGPT bietet viele Möglichkeiten zur Texterstellung und zur menschenähnlichen Kommunikation. In den Folgeartikeln steigen wir etwas tiefer in die Materie ein.

ChatGPT im Zeitalter von GPT-4 – die realen Fähigkeiten eines ChatBots

Nachdem wir uns im vorherigen Teil eingehend mit der Entstehungsgeschichte und den Lernmethoden beschäftigt haben, werden wir uns in diesem Teil die realen Fähigkeiten von ChatGPT ansehen.

Was kann ChatGPT?

ChatGPT ist ein Untermodell von GPT-3. Es basiert auf einer Transformer-Architektur und wird auf unüberwachte Weise trainiert, indem es das nächste Token in einer beliebigen Folge von Token vorhersagt.

Wenn man den Hype weglässt, ist ChatGPT in seiner Hauptfunktion ein sehr anspruchsvoller ChatBot. Im Gegensatz zu bisherigen Sprachmodellen sind die GPTs ab der Version GPT-2 zum ersten Mal multitaskingfähig.

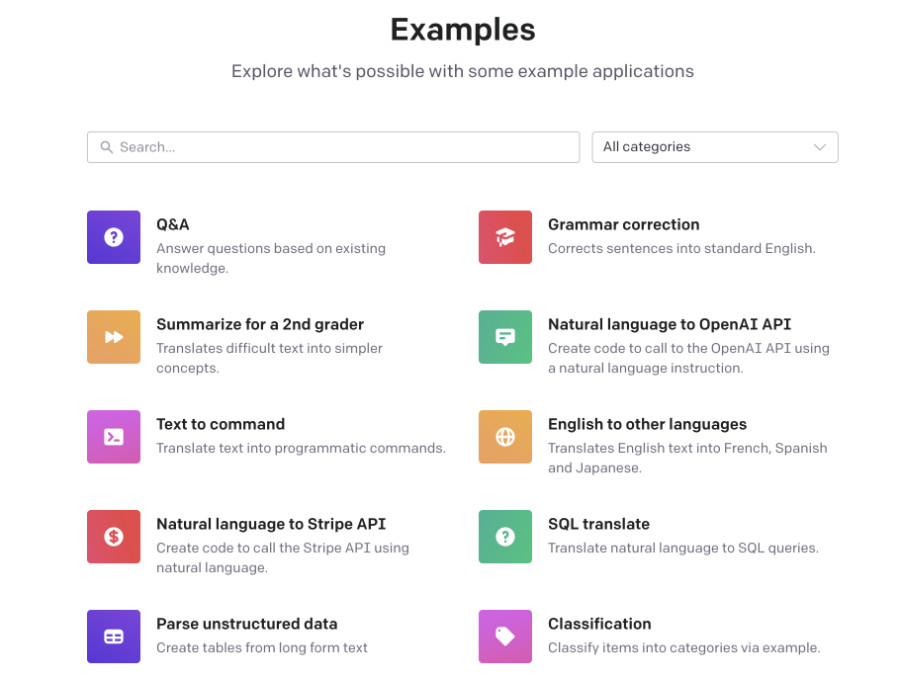

ChatGPT glänzt besonders durch folgende rationale Fähigkeiten:

Er ist außerdem ein ausgezeichneter Geschichtenerzähler:

Produktionssteigerung

Insgesamt bietet ChatGPT einige erstaunliche Möglichkeiten in Bezug auf NLP und kann erheblich dazu beitragen, deine Produktivität zu steigern. Anstatt ein komplexes System von Codes zu erlernen, kannst du ChatGPT in deinen eigenen Worten um etwas bitten.

Automatisierung von einfachen Aufgaben

Zu den grundlegenden Anwendungen zählt das Erledigen von Routineaufgaben. Er kann helfen, deinen Zeitplan zu organisieren, Besprechungen planen, Nachrichten beantworten und an Fristen erinnern.

Erschaffung von viralem Content für soziale Medien

ChatGPT kann Social-Media-Beiträge erstellen. Weil der ChatBot mit riesigen Datenmengen von Twitter trainiert wurde, kennt er die besten Formulierungen für Tweets.

Content-Ideen

ChatGPT ist ideal für neue Content-Ideen. Content-Creator brauchen immer wieder neue Ideen für ihre Kunden – ChatGPT führt ein Brainstorming durch, das sich gewaschen hat.

Beispiel:

Anfrage: "Entwickle einen Plot für einen Liebesroman, in dem eine Köchin vorkommt, die immer Schluckauf hat."

"Die Geschichte dreht sich um Emma, eine talentierte Köchin in einem eleganten Restaurant. Emma hat ein kleines Geheimnis – regelmäßig Schluckauf in den unpassendsten Momenten. Eines Nachts tritt ein gutaussehender Gast namens Alex ein..."

Etwas abgeschmackt vielleicht, aber im Großen und Ganzen gar nicht schlecht, oder?

Zielorientierte Artikel und Blogbeiträge

Je präziser du deine Anweisungen formulierst, desto höher ist die Wahrscheinlichkeit, dass der ChatBot einen fesselnden Text mit Call-to-Actions erstellt.

Codierung

ChatGPT ist hier wirklich revolutionär. Er kann als Programmierassistent eingesetzt werden, Fehler erkennen und sogar komplexere Codes wie ein komplettes WordPress-Plugin erstellen.

Vereinfachung komplexer Konzepte

ChatGPT erklärt komplizierte Konzepte, Prozesse und Phänomene auf eine leicht verständliche Art und Weise – und bleibt dabei auch noch charmant.

Was kann ChatGPT nicht?

Veralteter Trainingsdatensatz

Der Trainingskorpus hat keinen direkten Zugang zum Internet. ChatGPT ist auf das Jahr 2021 beschränkt. Es wird keine zutreffenden Antworten auf Fragen geben, die neuere Informationen erfordern.

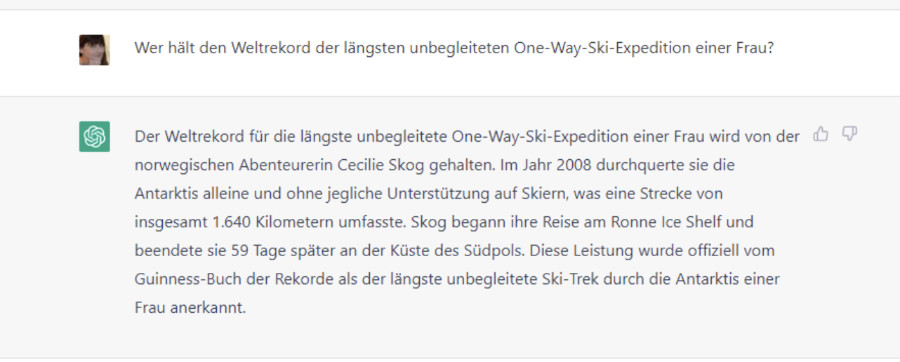

Forschungsphase und falsche Informationen

Der Chatbot befindet sich noch in einer Forschungsphase. Es kann vorkommen, dass plausibel klingende, aber falsche Antworten gegeben werden.

Die Hybris

ChatGPT kann einfach nicht zugeben, etwas nicht zu wissen. Es ist ein probabilistisches System – wann immer eine Lücke entsteht, füllt es diese mit dem nächstmöglichen Token. Dies nennen wir 'halluzinieren' oder 'fabulieren'.

Problematische Dienstleistung

Der Service wurde anfangs kostenlos zur Verfügung gestellt. Wegen Überlastung kommt es oft zu Engpässen. Außerdem läuft ChatGPT am besten auf Englisch.

Systematische Fehler

ChatGPT liefert oftmals unlogische Antworten auf mathematische Operationen und simple Rätsel. Kritiker haben darauf hingewiesen, dass das Programm Vorurteile der Trainingsdaten übernimmt.

Obwohl unterschiedliche Filterfunktionen eingeführt wurden, ist toxische Sprache immer noch ein problematischer Aspekt.

Ethische Bedenken

ChatGPT ist sicher eine bemerkenswerte Technologie. Allerdings birgt sie auch Gefahren. Es stellt sich die Frage nach der Nachhaltigkeit: Der Betrieb von ChatGPT kostet pro Tag etwa 3 Millionen USD. Allein das Pre-Training von GPT-3 hinterließ den gleichen CO2-Fußabdruck wie die Fahrt eines Autos zum Mond und zurück.

OpenAI setzte ausgelagerte kenianische Arbeiter ein, um toxischen Content zu labeln. Das Personal erhielt sehr geringe Entlohnung und empfand den toxischen Inhalt als eine regelrechte "Folter".

Schlusswort

Obwohl ChatGPT viele neue Möglichkeiten eröffnet, ist es wichtig, die Grenzen dieser heuristischen Technologie zu erkennen. Ein Textroboter stellt ein zuverlässigeres, deterministisch-regelbasiertes System dar. Anders als bei ChatGPT werden die Texte niemals erfunden oder falsch sein.

GPT-4 & ChatGPT vs. Textroboter: Für welche Einsatzbereiche ist welches Sprachmodell besser geeignet?

Nachdem wir in den ersten beiden Teilen auf die Entstehungsgeschichte und die realen Fähigkeiten eingegangen sind, widmen wir uns den verschiedenen Anwendungsgebieten.

GPT-4 bzw. ChatGPT

OpenAI's GPT-4 und ChatGPT sind beide anpassbare NLP-Modelle, die maschinelles Lernen nutzen, um natürlich klingende Antworten zu geben. GPT-4 generiert verschiedene Texttypen, während ChatGPT speziell auf Konversationen ausgerichtet ist.

GPT-4, ChatGPT, Textroboter – Wo liegen die Unterschiede?

Alle drei sind NLG-Technologien, die Texte in natürlicher Sprache erzeugen. GPT-4 ist ein probabilistisches Sprachmodell. Ein Textroboter arbeitet hingegen deterministisch (Data-to-Text) anhand eines spezifischen, strukturierten Datensatzes.

Was sind strukturierte Daten?

Attribute, die sauber in Tabellenform dargestellt werden können: Produktdaten aus einem PIM-System, Statistiken eines Fußballspiels oder Daten zu einer Hotel-Location.

Nutzer behalten stets die totale Kontrolle über den Output. Texte sind immer formal und inhaltlich korrekt. Sie können personalisiert und skaliert werden.

Alleinstellungsmerkmal: Sprachen

Der Textroboter generiert Texte in bis zu 110 Sprachen – nicht nur übersetzt, sondern auf Muttersprachenniveau lokalisiert. GPT-Modelle kreieren hingegen einzelne Texte in einzelnen Sprachen.

Skalierbarkeit

Der Textroboter kann in wenigen Sekunden Hunderte von Texten erstellen. ChatGPT und GPT-4 können nur einzelne Texte generieren. Mehrsprachigkeit wird nur in begrenzter Anzahl unterstützt.

In welchen Use-Cases eignen sich GPT-Modelle?

GPT-Modelle sind ideal für Ideenfindung oder als Grundlage für Blogbeiträge. Data-to-Text-Software ist am besten geeignet für Unternehmen mit hohem Bedarf an variablen Textinhalten.

Textroboter

Data-to-Text eignet sich für E-Commerce, Bankwesen, Finanzen, Pharmaindustrie, Medien und Verlage.

Das ist keine Magie. Das ist ideenreiche, regel- und mappingbasierte Programmierarbeit!

ChatGPT und GPT-4

GPT-Tools helfen beim Brainstorming und sind eine formidable Inspirationsquelle. Wann immer neue, brillante Ideen gebraucht werden, sind diese Sprachmodelle perfekt.

Welche Anforderungen birgt dein Textprojekt?

→ Textroboter, wenn:

- ✓ viel Content per Mouse-Klick updaten

- ✓ Kontrolle über Content-Qualität wichtig

- ✓ Texte personalisieren, z.B. in Ansprachen

- ✓ Texte gleichzeitig in diversen Sprachen

- ✓ keine Fehler oder falschen Aussagen

- ✓ kein Duplicate Content

- ✓ ethisch fragwürdige Statements = No-Go

- ✓ SEO-optimierte Texte nötig

- ✓ einheitliche Tonalität und Duktus

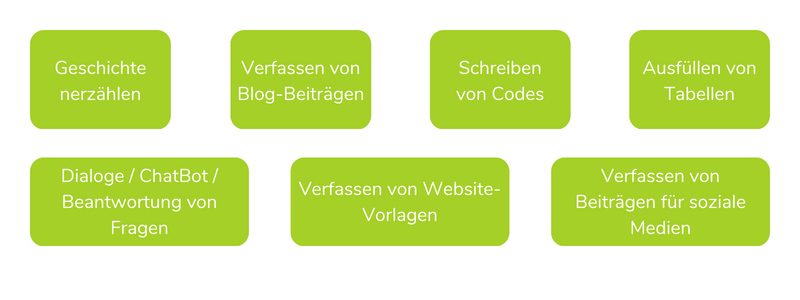

→ ChatGPT / GPT-4, wenn:

- ✓ Storytelling beauftragt

- ✓ Blogbeiträge schreiben

- ✓ Social Media Content

- ✓ Chatten oder Dialoge verwalten

- ✓ Website-Vorlagen benötigt

- ✓ Codes benötigt

- ✓ kein Datenkontext vorhanden

- ✓ einzelne Texte schnell und kostengünstig

- ✓ Bilder als Prompt nutzen

Meist trifft der Textroboter auf folgende Branchen zu:

Multimodalität zur Erweiterung des kreativen Schreibens

GPT-4 bleibt ein reines Sprachmodell, versteht jetzt aber auch Bilder, Videos und sogar Musik. Sogar Speech-to-Text ist damit möglich.

Text to Videos beim Textroboter

Kunden, die per API-Aufruf tausende Produktbeschreibungen produzieren, können auch tausende Produktvideos produzieren. Diese bestehen aus Bildern mit Ton, Stimme und Bullet-Point-Beschreibungen. Der Skalierungseffekt ist immens.

Schlusswort

GPT-4 und ChatGPT schreiben definitiv gute, humanoide Texte. Allerdings ist es wichtig, dir bewusst zu machen, welche Art von Text du wünschst. Die GPT-Modelle produzieren den wahrscheinlichsten Output. Da sie nicht wissen, wie die Welt funktioniert, können sie das Resultat weder verstehen noch bewerten. Bist du sicher, dass du dich damit zufriedengeben kannst?