Warum Unternehmen auf Datenzuordnung nicht verzichten sollten

Data Mapping spielt eine zentrale Rolle in der heutigen Datenverarbeitung. Wer Daten aus unterschiedlichen Quellen zusammenführt, muss sie strukturiert zuordnen – sonst drohen Datenverluste, Duplikate oder fehlerhafte Analysen. Die Datenzuordnung ist daher ein entscheidender Schritt bei der Datenintegration, bei jeder Datenmigration sowie beim Aufbau eines Data Warehouse.

Unternehmen, die auf konsistente und transparente Datenstrukturen setzen, erreichen nicht nur eine verbesserte Datenqualität, sondern schaffen auch die Basis für Automatisierung, Analyse und fundierte Entscheidungsfindung. Dieser Artikel zeigt, was Datenmapping genau ist, wie die Implementierung gelingt und welche Tools die Automatisierung erleichtern.

Definition und Bedeutung von Datenmapping

Einordnung in die Informatik und Unternehmenspraxis

Datenmapping beschreibt die gezielte Zuordnung von Datenfeldern aus einer Datenquelle zu den entsprechenden Feldern im Zielsystem – zum Beispiel bei der Überführung von Daten in eine neue Software, ein CRM-System oder ein Data Warehouse. Es ist der erste Schritt in der Datentransformation, oft verbunden mit Konvertierungen, Vereinheitlichungen und Anpassungen.

Die Beschreibung dieser Zuordnungen erfolgt meist in Form von Mapping-Regeln, die dokumentieren, wie Daten aus einer Quelle transformiert, verschoben oder gelöscht werden. So entsteht eine klare Struktur, die als technische und organisatorische Grundlage für eine erfolgreiche Datenmigration dient.

Für viele Unternehmen ist das Mapping keine Kür, sondern Pflicht – sei es bei der Einrichtung neuer Systeme, bei der Integration externer Daten oder zur Verbesserung der internen Datenqualität. Es sorgt für eine einheitliche Sicht auf Informationen, steigert die Effizienz, senkt den manuellen Aufwand und unterstützt Compliance-Anforderungen.

Warum Mapping von entscheidender Bedeutung ist

Wer Daten nicht richtig zuordnet, riskiert falsche Entscheidungen – oder im schlimmsten Fall Datenschutzprobleme und Systemausfälle.

Warum Data Mapping für Unternehmen von entscheidender Bedeutung ist

Datenintegration ohne Zuordnung? Ein Risiko für die gesamte Organisation

Viele Unternehmen setzen mittlerweile auf digitale Prozesse – sei es im Vertrieb, in der Buchhaltung oder im Kundenmanagement. Doch ohne eine klare Datenzuordnung bleibt die Integration dieser Systeme Stückwerk. Wenn Daten aus CRM, ERP oder Shop-Systemen zusammengeführt werden, ist Data Mapping (Datenmapping) unverzichtbar.

Denn: Unterschiedliche Datenformate, fehlende Standards oder nicht synchronisierte Datentypen machen die Datenmigration komplex. Ohne präzise Mapping-Regeln entsteht Chaos – mit negativen Folgen für Datenqualität, Konsistenz und letztlich die Entscheidungsfindung im Unternehmen.

Datenmapping sorgt hier für Ordnung: Es macht deutlich, woher die Daten stammen, wie sie zu interpretieren sind und wohin sie im Zielsystem gehören. Für die gesamte Organisation ist das die Grundlage für Transparenz, Sicherheit und optimale Nutzung aller Informationsressourcen.

Data Mapping als Schlüssel zur erfolgreichen Datenmigration

Die erfolgreiche Datenmigration hängt entscheidend von der Qualität des Mappings ab. Werden Quell- und Zielfelder nicht exakt zugeordnet, drohen:

Ein gutes Mapping dokumentiert nicht nur den technischen Weg, sondern beschreibt auch den Zweck jeder Transformation – etwa bei der Überführung in ein Data Warehouse oder bei der Anbindung neuer SaaS-Lösungen.

Tipp: Wer ein zentrales Mapping-Repository nutzt, reduziert den manuellen Aufwand bei künftigen Systemwechseln oder Datenänderungen erheblich.

Verbesserte Datenqualität durch strukturierte Datenverarbeitung

Datenqualität ist keine Frage des Zufalls, sondern der Struktur. Durch ein durchdachtes Datenmapping lassen sich:

Ein zentraler Effekt: Transparenz. Unternehmen wissen, woher die Daten stammen, wer sie nutzt und wie sie sich durch die Systeme bewegen. Diese Klarheit ist entscheidend – besonders bei Echtzeit-Auswertungen oder bei der Anbindung externer Datenquellen.

Eine fundierte Implementierung von Mapping-Prozessen verbessert nicht nur die operative Leistung, sondern auch die strategische Ausrichtung im Datenmanagement.

Relevanter Content-Tipp

Wer tiefer in die Automatisierung der Datenstruktur gehen will, findet hier vertiefende Infos zur Datenmodellierung & Automatisierung.

Auch lesenswert: Online-Datenbank erstellen – Schritt für Schritt erklärt

Umsetzung in der Praxis: Wie gelingt Data Mapping Schritt für Schritt?

Von der Festlegung bis zur Validierung: die Durchführung im Überblick

Die Durchführung eines erfolgreichen Data-Mapping-Prozesses erfordert mehr als nur technisches Know-how. Es geht um klare Struktur, strategische Festlegung von Mappings und den Einsatz passender Werkzeuge. Viele Unternehmen unterschätzen die Komplexität, die sich aus der Vielzahl von Systemen, Datenformaten und Zieldefinitionen ergibt. Eine durchdachte Implementierung ist daher entscheidend.

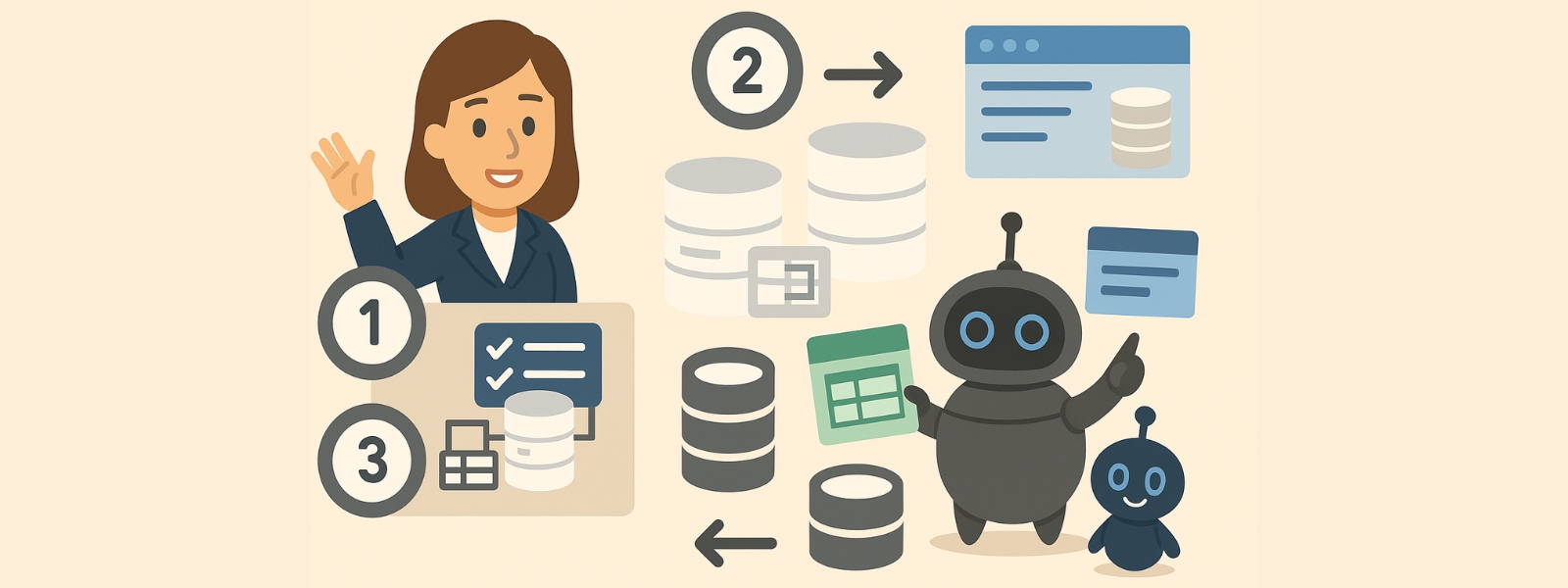

Hier ein bewährter Ablauf:

Schritt 1: Quelle und Zielsysteme definieren

Zuerst werden die relevanten Datenquellen und Zielsysteme identifiziert. Dabei sollte jedes relevante Datenmodell betrachtet werden – vom CRM über die Datenbank bis hin zum Data Warehouse.

Eine klare Definition reduziert spätere Fehler bei der Verarbeitung und Validierung.

Schritt 2: Datenfelder analysieren und Mapping-Regeln erstellen

Jetzt erfolgt die eigentliche Datenzuordnung – also die Erstellung von Mapping-Regeln. Dabei geht es nicht nur um 1:1-Zuordnungen, sondern auch um:

Dabei entsteht ein dokumentiertes Regelwerk, das sich bei jeder Aktualisierung leicht anpassen lässt – ein zentraler Vorteil für die Wartung und langfristige Optimierung.

🔍 Tipp: Talend bietet eine gute Übersicht zu grafischen Mapping-Tools und automatisierten Prozessen – ideal zur Reduktion des manuellen Aufwands.

Schritt 3: Validierung, Test und Echtbetrieb

Bevor Daten produktiv laufen, müssen sie getestet, validiert und freigegeben werden. Dazu zählen:

Erst nach erfolgreicher Prüfung erfolgt der Rollout in den Echtzeitbetrieb – idealerweise mit Monitoring-Funktion, Logging und automatisierter Dokumentation.

Tools und Hilfsmittel zur Optimierung

Gerade bei steigender Datenkomplexität lohnt der Einsatz spezialisierter Tools, z. B.:

Mehr dazu findest du im Vergleich von Content-Management-Systemen mit Automatisierung – gerade für kleinere Betriebe sehr hilfreich.

Data Mapping im Data Warehouse: Struktur schaffen, Datenströme steuern

Warum Datenzuordnung im Warehouse unverzichtbar ist

Ein Data Warehouse ist das Rückgrat datengetriebener Entscheidungen. Hier laufen Informationen aus unterschiedlichsten Quellsystemen zusammen – CRM, ERP, E-Commerce, Marketingplattformen oder externe APIs. Damit diese Datenintegration funktioniert, braucht es ein durchdachtes Data Mapping, das die gesamte Datenbewegung strukturiert und absichert.

Denn im Warehouse gilt: Nur was eindeutig zugeordnet ist, kann später in Reports, Dashboards und Analysen verwendet werden. Unklare Formate, doppelte Datensätze oder fehlende Konvertierungen führen zu unbrauchbaren Ergebnissen – mit direkten Folgen für Entscheidungen und Compliance.

Datenmapping als Herzstück jeder ETL-Strecke

Im ETL-Prozess (Extract – Transform – Load) nimmt das Mapping eine zentrale Rolle ein:

Besonders in der Transformation liegt der Fokus auf Datentypen, Formaten, Umcodierungen und der korrekten Zuordnung aller Felder – etwa wenn Adressen standardisiert oder Zahlenformate angepasst werden.

Eine tiefergehende Erklärung der Mapping-Rolle im ETL liefert InsightSoftware in diesem Fachbeitrag:

What is Data Mapping – InsightSoftware

Mapping im Data Warehouse: typische Herausforderungen

Bei der Implementierung von Mappings im Warehouse stoßen Unternehmen auf zahlreiche Herausforderungen:

Um diese Komplexität zu beherrschen, braucht es strukturierte Vorgehensweisen und leistungsfähige Tools, die auch bei Änderungen schnell reagieren können – ohne die gesamte Pipeline neu aufzubauen.

Dokumentation und Wartung: Pflicht im Datenmanagement

Ein zentrales Problem vieler Organisationen ist die fehlende oder unvollständige Dokumentation von Mapping-Prozessen. Gerade bei personellen Wechseln, neuen Tools oder System-Updates ist es entscheidend, die Regeln für Datenströme klar nachvollziehbar festzuhalten.

Empfehlung:

Dies erhöht nicht nur die Transparenz, sondern sichert langfristig die Leistungsfähigkeit des gesamten Datenmanagements.

Praxis-Tipp für kleine Unternehmen

Auch wenn ein Warehouse wie ein Großprojekt klingt: Selbst kleine Unternehmen profitieren enorm von einer klaren Mapping-Struktur – etwa bei der Anbindung von Shopsystemen oder bei der Migration auf ein neues CRM. Wer einmal die Zuordnung klärt, kann künftige Datenmigrationen deutlich schneller und sicherer abwickeln.

Zusätzliche Impulse bietet der Beitrag zur Datenbank-Erstellung für KMU – auch im Zusammenspiel mit einem Warehouse-Ansatz interessant.

Optimierung von Mapping-Prozessen und nachhaltige Datenqualität

Warum Mapping kein Einmal-Projekt ist

Viele Unternehmen behandeln Data Mapping als Projekt mit klarem Anfang und Ende. In der Praxis ist das jedoch selten so. Systeme ändern sich, neue Datenquellen kommen hinzu, und die Anforderungen an Echtzeitverarbeitung, Compliance oder Berichterstattung wachsen stetig. Deshalb ist die kontinuierliche Optimierung von Mapping-Prozessen entscheidend für langfristigen Erfolg.

Potenziale für bessere Ergebnisse und weniger Aufwand

Gut strukturierte Datenzuordnungen lassen sich durch verschiedene Maßnahmen effizienter gestalten:

Die Nutzung intelligenter Tools spart nicht nur Zeit, sondern reduziert auch das Risiko von Fehlern bei der Datenverarbeitung und Löschung. Gleichzeitig verbessert sich die Übersicht über den gesamten Datenfluss – von der Quelle bis zur Zielstruktur.

Wer sich tiefer mit den theoretischen Grundlagen beschäftigen möchte, findet eine gute Einführung bei StudySmarter zum Thema Datenmapping.

Messbare Verbesserung der Datenqualität

Optimiertes Datenmapping wirkt sich unmittelbar auf die Qualität der gespeicherten und verarbeiteten Daten aus:

Gerade bei datengetriebenen Unternehmen ist eine hohe Datenqualität das Fundament für zuverlässige Analyse, präzise Prognosen und automatisierte Geschäftsprozesse.

Relevanter Tool-Tipp

Viele kleinere Unternehmen unterschätzen die Komplexität wachsender Datenmengen. Tools zur Datenautomatisierung, wie sie auch im KI-Textgenerator-Test vorgestellt werden, helfen, den Überblick zu behalten – auch außerhalb des reinen Contents.

Automatisierung und Monitoring nicht vergessen

Ein wichtiger Schritt in der Implementierung nachhaltiger Mapping-Prozesse ist die Automatisierung der Überwachung:

So entsteht ein kontrollierter, dokumentierter Datenprozess, der über Jahre hinweg gepflegt werden kann – unabhängig davon, wie stark sich die IT-Umgebung verändert.

Praxisbeispiel: Wie Data Mapping in der Informatik und im Content-Management funktioniert

Ein realistisches Szenario: strukturierte Datenintegration für Content

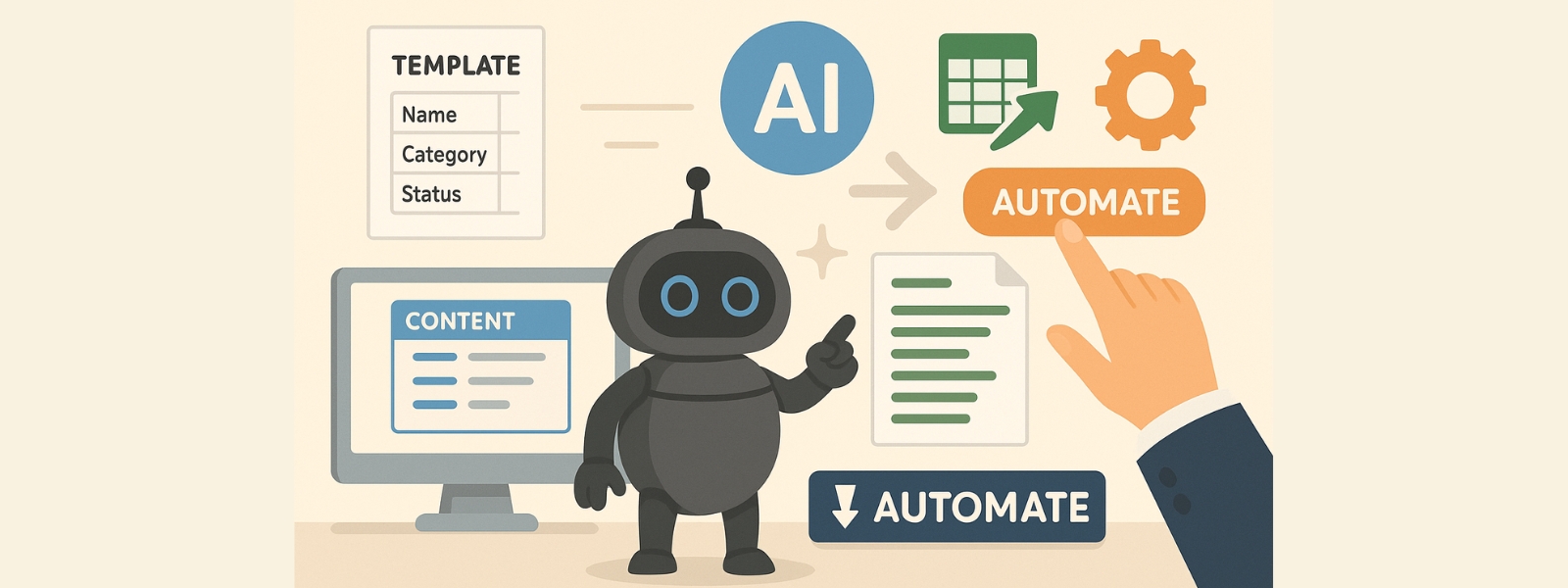

Ein mittelständisches Unternehmen möchte Inhalte wie Blogartikel, Newsletter oder Branchen-News automatisch aus einer internen Datenbank generieren – etwa aus Produktdaten, CRM-Feldern oder Event-Listen. Die Herausforderung: Diese Datenquellen sind technisch unterschiedlich aufgebaut, die Formate uneinheitlich, die Datenstruktur schwer skalierbar.

Die Lösung: Datenmapping, das aus rohen Informationen strukturierte Inhalte macht. Jede Datenzuordnung wird dokumentiert, mit klaren Regeln für Transformation, Validierung und ggf. Löschung. Damit werden Rohdaten in verwertbare Textbausteine übersetzt – ohne manuelles Copy-Paste oder Medienbrüche.

Umsetzung mit dem uNaice ContentNaicer

Hier kommt der uNaice ContentNaicer ins Spiel – ein intelligentes Content-System, das auf automatisiertem Mapping basiert. Er verbindet strukturierte Datenverarbeitung mit KI-gestützter Texterstellung. Die Implementierung läuft in mehreren Schritten:

So entsteht ein nahtloser Prozess – von der Rohinformation bis zur publizierbaren Ausgabe, komplett ohne manuellen Redaktionsaufwand.

Wer das System testen will, kann eine Demo vereinbaren und den uNaice ContentNaicer im eigenen Use Case erleben.

Datenschutz, Transparenz und Rückverfolgbarkeit

Durch die vollständige Dokumentation der Mapping-Regeln erfüllt der Content Naicer höchste Anforderungen an Transparenz und Nachvollziehbarkeit. So lassen sich nicht nur Inhalte effizient erstellen, sondern auch Compliance-Vorgaben einhalten und Datenlöschungen systematisch abbilden.

Für tiefergehendes Verständnis von Mapping und Datenschutz lohnt ein Blick in den Beitrag von BigID:

Data Mapping und Datenschutz – BigID.

Fazit: Vom Datenfeld zum Content – automatisiert und skalierbar

Gerade in dynamischen Umfeldern, in denen regelmäßig neue Inhalte gebraucht werden, ist ein automatisiertes System wie der Content Naicer ein entscheidender Vorteil. Die Kombination aus strukturiertem Mapping, Datenintegration und intelligenter Textgenerierung schafft Effizienz, Konsistenz und Relevanz – bei minimalem Aufwand für das Team.

Fazit und Empfehlungen für die praktische Umsetzung

Warum Datenmapping zur Grundausstattung jeder digitalen Strategie gehört

Ob CRM-System, E-Commerce-Backend oder interner Redaktionsprozess: Wer Daten nutzt, muss sie verstehen, richtig zuordnen und klar dokumentieren. Genau das leistet ein durchdachtes Datenmapping – und zwar nicht nur in der IT, sondern in der gesamten Organisation.

Das Mapping von Datenfeldern, die saubere Integration in bestehende Prozesse und die Einbindung in Tools und Automatisierungen ist heute keine Kür mehr – sondern notwendige Grundlage für funktionierende Systeme, transparente Abläufe und skalierbare Inhalte.

Die drei wichtigsten Empfehlungen auf einen Blick

Tool-Empfehlung zum Abschluss

Wer tiefer in das Thema Mapping-Tools einsteigen will, findet bei Astera einen guten Überblick über kommerzielle und frei verfügbare Softwarelösungen – von Low-Code-Plattformen bis zu ETL-Werkzeugen mit integrierter Mapping-Logik.

Letzter Impuls: Inhalte aus Daten – automatisiert, aktuell, effizient

Wenn du regelmäßig strukturierte Daten in Inhalte übersetzen willst – egal ob für Kundenportale, interne Kommunikation oder deinen Blog – lohnt ein Blick auf den uNaice ContentNaicer. Das System verarbeitet Rohdaten intelligent, wandelt sie automatisiert um und sorgt für saubere, veröffentlichungsfertige Inhalte.

Starte jetzt mit einer Demo oder Testanfrage – direkt aus deinen vorhandenen Systemen.

FAQ: Häufige Fragen rund um Datenmapping

Jetzt kostenlos beraten lassen

Lass uns gemeinsam schauen, ob wir dir weiterhelfen können.

Jetzt kontaktieren